Theo trang công nghệ Wired, việc Apple mạnh tay mua lại công nghệ của các công ty khác nhằm mang nó lên các sản phẩm của họ không phải là một điều gì đó lạ lẫm. Điều khiến mọi người đều ngạc nhiên là, vào thời điểm đó, không ai biết được "Quả táo khuyết" có dự định gì với những công nghệ còn quá xa vời như vậy. Và cho đến khi Apple giới thiệu iPhone X, người ta mới ngã ngửa ra rằng: Apple đã chuẩn bị cho chiếc iPhone này từ rất lâu rồi.

Có lẽ tính năng quan trọng bậc nhất khi nhắc đến iPhone X chính là công nghệ theo dõi khuôn mặt, cho phép người dùng mở khoá màn hình bằng khuôn mặt hoặc biến biểu cảm khuôn mặt người dùng thành những biểu tượng emoji động 3D mà chúng ta được biết dưới tên gọi Animoji.

Apple cho rằng, iPhone X là đại diện cho tương lai của công nghệ di động và nhiều người hoàn toàn đồng ý với điều này. Tuy nhiên, bạn có biết rằng nếu truy lại nguồn gốc của những công nghệ ấn tượng trên iPhone X, hầu hết chúng đều được nghiên cứu và phát triển trong các phòng thí nghiệm gồm toàn những sinh viên mới tốt nghiệp. Trong trường hợp Animoji, công nghệ theo dõi khuôn mặt đã được nghiên cứu từ gần một thập kỷ trước, tại hai trong số những trường công nghệ uy tín bậc nhất châu Âu.

Tiến trình phát triển của công nghệ theo dõi khuôn mặt

Cho tới giữa thập niên 2000, công nghệ bắt chuyển động (motion capture) vẫn còn đang được nghiên cứu tích cực trong phòng thí nghiệm. Ví dụ, để tạo nên những biểu cảm khuôn mặt hết sức chân thực mà bạn thấy trong phim Avatar, người diễn viên phải đeo một chiếc mặt nạ được in các chấm nhỏ trên mặt, và gắn các trái banh nhựa nhỏ lên cơ thể. Những chấm đó gọi là "marker", cho phép hệ thống quang học theo dõi và tính toán các chuyển động trên cơ thể và khuôn mặt, từ đó tái tạo lại quá trình thay đổi của chúng.

Công nghệ "marker" tuy hữu dụng nhưng đòi hỏi sự chuẩn bị rất phức tạp và tốn rất nhiều thời gian: cần có một studio, một bộ đồ bắt chuyển động, và các diễn viên không ngại khó để mặc các bộ đồ đầy chấm này. Để đơn giản hoá mọi việc, Hao Li - giám đốc phòng thí nghiệm USC Vision and Graphics, cùng các cộng sự là Thibaut Weise, Brian Amberg và Sofien Bouaziz (hiện đều là nhân viên Apple) đã nghiên cứu cách thay thế bộ đồ bắt chuyển động và "marker" bằng các thuật toán có khả năng theo dõi biểu cảm khuôn mặt thông qua các đoạn phim ngắn được quay bởi các máy quay có thể cảm nhận chiều sâu. Mục đích của họ là tạo nên các ảnh đại diện (avatar) kỹ thuật số có khả năng nhại lại biểu cảm của con người trong thời gian thực.

Thuật toán này có một vấn đề: quá khó để thực hiện, bởi theo Hao Li thì "khuôn mặt người là một trong những giới hạn lớn nhất đối với đồ hoạ máy tính". Không như các vật thể tĩnh khác, khuôn mặt con người luôn biến đổi không theo bất kỳ quy luật đơn giản nào mà máy tính có thể tính toán được.

Để máy tính có thể hiểu được quá trình chuyển động của khuôn mặt, nó cần phải hiểu được mọi góc cạnh của khuôn mặt.

"Các thuật toán cần phải cực kỳ nhạy cảm đối với sự thay đổi ánh sáng môi trường, các cử động xoay đầu, các thuộc tính khác nhau của khuôn mặt thuộc các chủng tộc và tuổi tác khác nhau" - Dino Paic, Giám đốc Kinh doanh và Marketing của Visage Technologies, công ty sở hữu phần mềm theo dõi khuôn mặt được sử dụng bởi nhiều đối tác chuyên về xe hơi và tài chính, cho biết.

Đến giữa thập niên 2000, các camera 3D có khả năng cảm nhận độ sâu đã được hoàn thiện, đáp ứng được nhu cầu "bắt" lại toàn bộ khuôn mặt con người. Lúc này, vấn đề tiếp theo là làm sao để dạy máy tính cách xử lý các dữ liệu thu được.

"Vấn đề là dù bạn có thể chụp lại mọi điểm trên khuôn mặt thì chúng (các dữ liệu thu được) cũng chẳng có ý nghĩa gì đối với máy tính" - Hao Li nói.

Để giải quyết việc này, Li và nhóm của ông đã "hình học hoá" khuôn mặt. Họ huấn luyện các thuật toán của mình đọc hàng trăm khuôn mặt và biểu cảm để chúng có thể xây dựng nên các mẫu hình 3D miêu tả đúng một khuôn mặt trông như thế nào đối với các chủng tộc và môi trường khác nhau. Với mẫu hình 3D được dựng nên này, thuật toán có thể dễ dàng ghép nối các điểm trên khuôn mặt và tạo nên các ảnh đại diện (avatar) nhại lại biểu cảm khuôn mặt trong thời gian thực.

Giá trị của khuôn mặt

Từ quá trình phát triển nêu trên, hiện các công ty chuyên về hiệu ứng hình ảnh đã và đang sử dụng công nghệ này vào quá trình sản xuất. Còn đối với người dùng thông thường, họ sẽ sớm được trải nghiệm công nghệ này thông qua tính năng Animoji của Apple, hay Pocket Avatar của Intel - đều là những tính năng tận dụng công nghệ nhận diện khuôn mặt người dùng để chuyển thành một ảnh đại diện kỹ thuật số.

Hao Li cho rằng các emoji nhại lại khuôn mặt người dùng chỉ là sự khởi đầu. Ông đang điều hành Pinscreen - một startup với tham vọng tự động hoá quá trình tạo nên các sản phẩm đồ hoạ máy tính siêu thực - nơi ông và nhóm của mình nghiên cứu và phát triển công nghệ cho phép các thuật toán có thể dựng nên các ảnh đại diện 3D siêu thực chỉ từ một nguồn ảnh đơn lẻ.

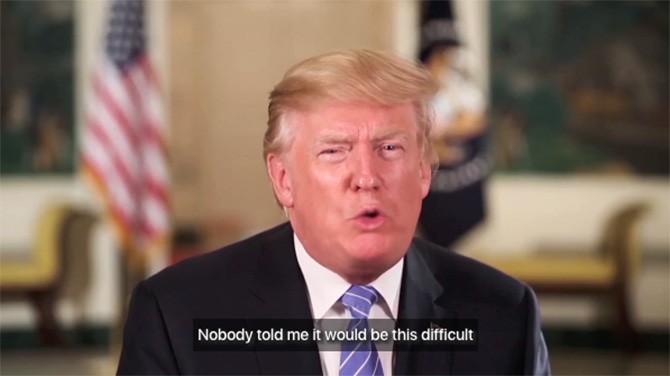

Sau đợt bầu cử Tổng thống Mỹ hồi cuối năm ngoái, Pinscreen đã tung ra một đoạn clip demo, trong đó cho thấy họ đã tạo ra một seri ảnh GIF Tổng thống Donald Trump đang nhảy. Tất nhiên, hình ảnh render này vẫn chưa được trau chuốt, nhưng cũng đã cho thấy một tương lai nơi bất kỳ ai cũng có thể tạo ra một ảnh đại diện như thật, có khả năng nói và làm bất kỳ điều gì họ muốn.

Công nghệ của Pinscreen vẫn đang ở giai đoạn beta, nhưng nhiều người cho rằng việc họ cố gắng đưa công nghệ này đến với càng nhiều người càng tốt một mặt rất thú vị, mặt khác ẩn chứa những nguy cơ tiềm ẩn về giả mạo danh tính. Bởi khi công nghệ này được cải tiến hơn nữa, chúng ta sẽ khó mà biết được ranh giới giữa thật và ảo!

Đây là tác phẩm của Pinscreen. Bạn có nhận ra đây chỉ là ảnh đại diện (avatar) của Donald Trump chứ không phải người thật không?